OpenAI признала способность ChatGPT для создания биологического оружия

Как стало известно Icma.az, со ссылкой на сайт Vesti.

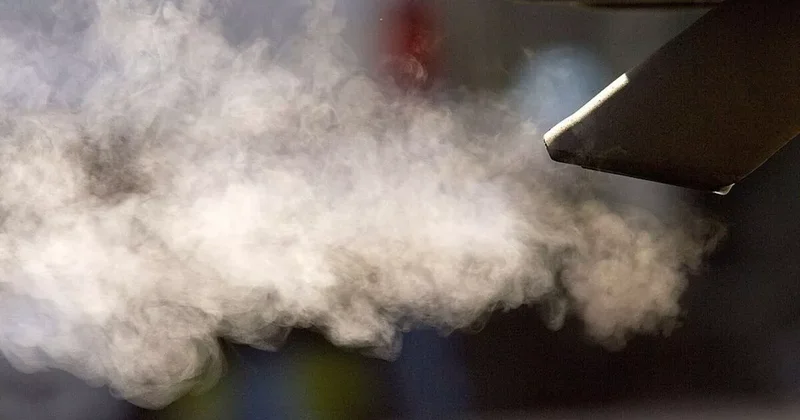

Руководители OpenAI предупредили, что их следующее поколение моделей искусственного интеллекта (ChatGPT) может нести новые риски – вплоть до создания биологического оружия, позволят людям без научного образования создавать потенциально опасные вещества.

Хотя точные сроки появления высокорисковых ИИ не называются, глава отдела систем безопасности OpenAI Йоханнес Хайдеке подчеркнул, что "некоторые из преемников o3 достигнут этого уровня".

"Мы еще не в том мире, где есть что-то новое, совершенно неизвестное, создающее биологические угрозы, которые не существовали ранее. Мы больше беспокоимся о воспроизведении вещей, с которыми уже хорошо знакомы эксперты", – пояснил Хайдеке.

Сложность ограничения ИИ заключается в том, что некоторые из тех же возможностей, которые могли бы позволить большим языковым моделям (LLM) совершать прорывы в медицине, также могут быть использованы во вред.

Он признал, что OpenAI и другим компаниям нужны системы обнаружения, способные предотвращать вредоносное использование с точностью выше 99%, а лучше – в пределах одного случая на сто тысяч. Вместе с тем важен человеческий надзор: мониторинговые команды должны быстро реагировать на инциденты, которые обходят автоматическую фильтрацию, и оперативно устранять потенциальную угрозу.

Еще в 2024 году OpenAI заявляла о разработке системы раннего предупреждения, способной блокировать попытки использования ChatGPT для получения данных, которые могли бы способствовать созданию биологического оружия. В апреле была внедрена система наблюдения за моделями o3 и o4-mini, отслеживающая потенциально опасные запросы, связанные с химическими и биологическими угрозами. Эти меры направлены на то, чтобы ИИ не давал инструкций, способных привести к разработке реального оружия.

Накануне ученные впервые нашли доказательства того, что ИИ может мыслить как человек. Это открытие может повлиять на развитие ИИ и изменить подход к оценке его когнитивных способностей.

Другие новости на эту тему:

Другие новости на эту тему: Просмотров:128

Просмотров:128 Эта новость заархивирована с источника 20 Июня 2025 17:54

Эта новость заархивирована с источника 20 Июня 2025 17:54

Войти

Войти

Online Xəbərlər

Online Xəbərlər Новости

Новости Погода

Погода Магнитные бури

Магнитные бури Время намаза

Время намаза Калькулятор колорий

Калькулятор колорий Драгоценные металлы

Драгоценные металлы Конвертор валют

Конвертор валют Кредитный калькулятор

Кредитный калькулятор Курс криптовалют

Курс криптовалют Гороскоп

Гороскоп Вопрос - Ответ

Вопрос - Ответ Проверьте скорость интернета

Проверьте скорость интернета Радио Азербайджана

Радио Азербайджана Азербайджанское телевидение

Азербайджанское телевидение О нас

О нас

TDSMedia © 2025 Все права защищены

TDSMedia © 2025 Все права защищены

Самые читаемые

Самые читаемые