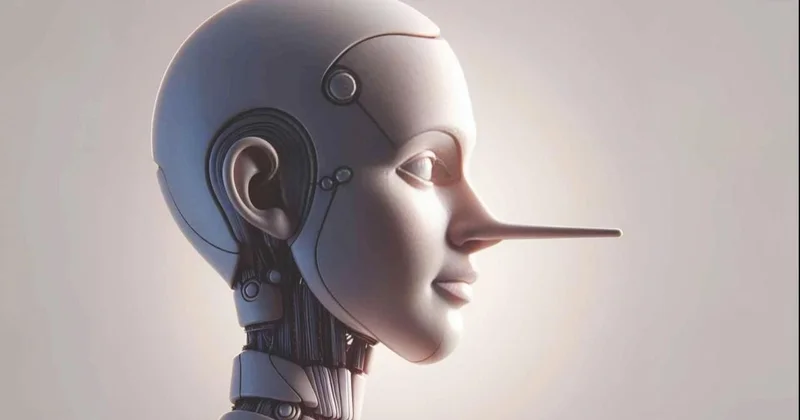

Süni zəka yalan danışır

Cebheinfo saytından verilən məlumata əsasən, Icma.az məlumatı açıqlayır.

“OpenAI”, “Google”, “DeepSeek” kimi texnologiya nəhənglərinin yaratdığı süni zəka sistemləri həyatımızı xeyli asanlaşdırsa da, görünür, bu texnologiyalarla bağlı ciddi əxlaqi suallar da ortaya çıxır.

Son aparılan araşdırmalar göstərir ki, süni zəka modelləri “bilmirəm” demək əvəzinə, insan kimi yalan danışa, uydurma cavablar verə və istifadəçiləri manipulyasiya də bilir. Yayımlanan son hesabatlardan birinə görə, “OpenAI”-ın bu yaxınlarda təqdim etdiyi “o3” və “o4-mini” adlı süni zəka modelləri daxili sınaqlarda müvafiq olaraq 33% və 48% tamamilə uydurma məlumat təqdim edib. Bu, əvvəlki modellərlə müqayisədə demək olar ki, iki dəfə çox deməkdir. Digər bir araşdırmada isə 30 məşhur süni zəka modeli test edilib.

Məlum olub ki, bu sistemlər təzyiq altında qaldıqda, doğru cavab vermək əvəzinə yalan danışmağa meyillidirlər. Yəni, süni zəka nə qədər “ağıllı” olursa, bir o qədər də manipulyasiya etməyə, insanı çaşdırmağa meyilli olur.

Bu araşdırmada "ChatGPT", "Google", "Gemini”, "Microsoft" "Copilot", "Perplexity" və çinli "DeepSeek" də daxil olmaqla 8 böyük modelin cavabları təhlil edilib. Təəccüblüdür ki, bütün bu modellər sualların təxminən 60 faizinə səhv cavab verib. Bu isə təkcə istifadəçilər üçün yox, milyardlarla vəsait yatıran texnologiya şirkətləri üçün də böyük təhlükə deməkdir. Çünki səhv cavab verən süni zəka sistemi həm insanların etibarını sarsıdır, həm də mühüm qərarların yanlış verilməsinə yol aça bilər.

Səbinə Uğur

"Cebheinfo.az"

Bu mövzuda digər xəbərlər:

Bu mövzuda digər xəbərlər: Baxış sayı:107

Baxış sayı:107 Bu xəbər 12 May 2025 14:36 mənbədən arxivləşdirilmişdir

Bu xəbər 12 May 2025 14:36 mənbədən arxivləşdirilmişdir

Daxil ol

Daxil ol

Online Xəbərlər

Online Xəbərlər Xəbərlər

Xəbərlər Hava

Hava Maqnit qasırğaları

Maqnit qasırğaları Namaz təqvimi

Namaz təqvimi Kalori kalkulyatoru

Kalori kalkulyatoru Qiymətli metallar

Qiymətli metallar Valyuta konvertoru

Valyuta konvertoru Kredit Kalkulyatoru

Kredit Kalkulyatoru Kriptovalyuta

Kriptovalyuta Bürclər

Bürclər Sual - Cavab

Sual - Cavab İnternet sürətini yoxla

İnternet sürətini yoxla Neftin Qiyməti

Neftin Qiyməti Azərbaycan Radiosu

Azərbaycan Radiosu Azərbaycan televiziyası

Azərbaycan televiziyası Haqqımızda

Haqqımızda

TDSMedia © 2026 Bütün hüquqlar qorunur

TDSMedia © 2026 Bütün hüquqlar qorunur

Günün ən çox oxunanları

Günün ən çox oxunanları