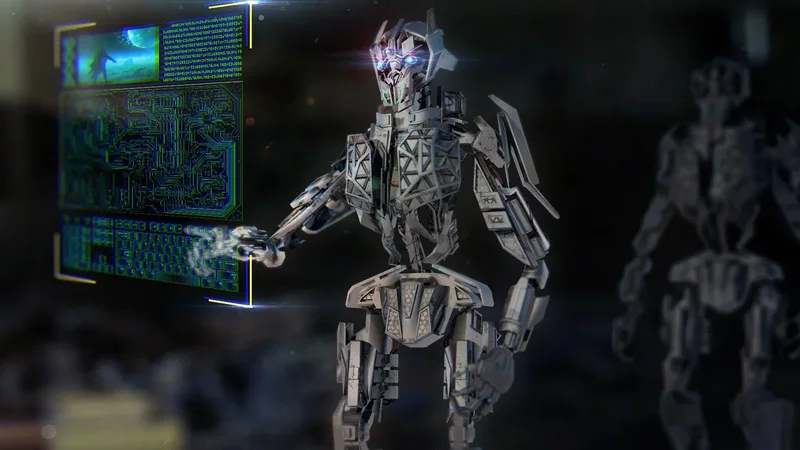

Süni intellektin xaç atası qorxur: Bizi məhv edə biləcək şeylər istehsal edirik

Icma.az, Qaynarinfo portalına istinadən məlumatı açıqlayır.

Süni intellekt texnologiyaları son illərdə inanılmaz dərəcədə sürətlə inkişaf edib. Lakin bu sahənin öncülləri bu inkişafın mümkün nəticələrindən dərin narahatlıq keçirirlər. Süni intellektin gələcəyi ilə bağlı xəbərdarlıqlar edən elm adamlarının sırasına indi də Yoşua Benqio qoşulub.

Qaynarinfo "Business Insider"ə istinadən xəbər verir ki, yanvar ayında İsveçrənin Davos şəhərində keçirilən Dünya İqtisadi Forumu (WEF) çərçivəsində çıxış edən Benqio süni intellektin idarəolunmaz hala gəlməsindən narahatlığını ifadə edib.

Bu il forumun əsas mövzularından biri insan müdaxiləsi olmadan hərəkət edə bilən süni intellekt agentləri olub. Mövzuya həsr olunmuş paneldə alimlər bu texnologiyanın gələcəyi və onun idarə olunmasının yolları haqqında müzakirələr aparıblar.

Paneldə ən çox müzakirə edilən məsələlərdən biri ümumi süni intellekt (AGI) mərhələsinə – yəni maşınların insan səviyyəsində məntiqi düşünmə qabiliyyətinə nə vaxt çatacağına dair proqnozlar olub.

Benqio forum çərçivəsində "Business Insider" nəşrinə verdiyi açıqlamada "AGI və ya süper intellektlə bağlı bütün fəlakət ssenariləri süni intellekt agentlərinin yaradılması ilə gerçək olur" deyib. O, AGI-nin mütləq agentik sistemlər (müstəqil qərar qəbul edə bilən sistemlər) vasitəsilə əldə olunmasının vacib olmadığını bildirib.

Benqio əlavə edib ki, elmi və tibbi sahələrdə süni intellektin tətbiqləri agentik olmadan da inkişaf etdirilə bilər: "Agentik olmayan daha güclü sistemlər yaratmağa davam edə bilərik".

Rəqabət qorxusu nəzarətsiz inkişafı stimullaşdırır

Kanadalı alim Benqio dərin öyrənmə və neyron şəbəkələri sahəsindəki araşdırmaları ilə süni intellekt inqilabının əsas memarlarından biridir. O, Coofri Hinton və Yan Lekun ilə birlikdə "süni intellektin ataları" arasında göstərilir. Hinton kimi Benqio da vaxtaşırı süni intellektin potensial təhlükələri barədə xəbərdarlıqlar edir və risklərin qarşısını almaq üçün qlobal səviyyədə birgə fəaliyyətə çağırır.

Son illərdə süni intellekt agentlərini sınaqdan keçirən şirkətlər bu texnologiyaya qoyduqları sərmayənin nəticələrini artıq görməyə başlayıblar. Süni intellektin yaxın gələcəkdə daha geniş miqyasda iş dünyasına inteqrasiya ediləcəyi gözlənilir.

Məsələn, "OpenAI" internetdə istifadəçilər üçün axtarış aparıb otel rezervasiyası edə bilən və ya alış-veriş səbətinə məhsullar əlavə edən yeni bir məhsul təqdim edib. "Google" da oxşar bir xidməti istifadəyə verməyə hazırlaşır.

Benqionun əsas narahatlığı isə insanların bu texnologiyaların təhlükələrinə baxmayaraq, agentik süni intellekt sistemlərini inkişaf etdirməkdə israr etməsidir. Çünki rəqabət aparan şirkətlər və dövlətlər bu sahədə geri qalmaqdan çəkinirlər.

Bununla belə, Benqio ümidverici bir məqamın olduğunu da vurğulayıb: "Yaxşı xəbər odur ki, əgər agentik olmayan sistemlər inşa etsək, onlar agentik sistemləri nəzarət altında saxlamaq üçün istifadə edilə bilər".

O, bu məqsədə çatmağın yollarından birinin daha inkişaf etmiş "nəzarətçi" sistemlər qurmaq olduğunu qeyd edib. Bunun isə ciddi sərmayə tələb etdiyini əlavə edib.

Benqio həmçinin, süni intellekt şirkətlərinin agentik modelləri təhlükəsizlik sübutları olmadan inkişaf etdirməsinin qarşısını almaq üçün milli tənzimləmə mexanizmlərinə ehtiyac olduğunu vurğulayıb.

"Güvənli və bacarıqlı süni intellekt elmi inkişaf etdirə bilər. Lakin risklərin fərqində olmalı, onların haradan qaynaqlandığını elmi cəhətdən başa düşməli və çox gec olmadan bu problemlərin qarşısını almaq üçün texnologiyaya sərmayə qoymalıyıq. Hazırda bizi məhv edə biləcək texnologiyalar yaradırıq", deyə Benqio xəbərdarlıq edib.

Aydın

Bu mövzuda digər xəbərlər:

Bu mövzuda digər xəbərlər: Baxış sayı:72

Baxış sayı:72 Bu xəbər 24 Fevral 2025 22:52 mənbədən arxivləşdirilmişdir

Bu xəbər 24 Fevral 2025 22:52 mənbədən arxivləşdirilmişdir

Daxil ol

Daxil ol

Online Xəbərlər

Online Xəbərlər Xəbərlər

Xəbərlər Hava

Hava Maqnit qasırğaları

Maqnit qasırğaları Namaz təqvimi

Namaz təqvimi Kalori kalkulyatoru

Kalori kalkulyatoru Qiymətli metallar

Qiymətli metallar Valyuta konvertoru

Valyuta konvertoru Kredit Kalkulyatoru

Kredit Kalkulyatoru Kriptovalyuta

Kriptovalyuta Bürclər

Bürclər Sual - Cavab

Sual - Cavab İnternet sürətini yoxla

İnternet sürətini yoxla Azərbaycan Radiosu

Azərbaycan Radiosu Azərbaycan televiziyası

Azərbaycan televiziyası Haqqımızda

Haqqımızda

TDSMedia © 2026 Bütün hüquqlar qorunur

TDSMedia © 2026 Bütün hüquqlar qorunur

Günün ən çox oxunanları

Günün ən çox oxunanları