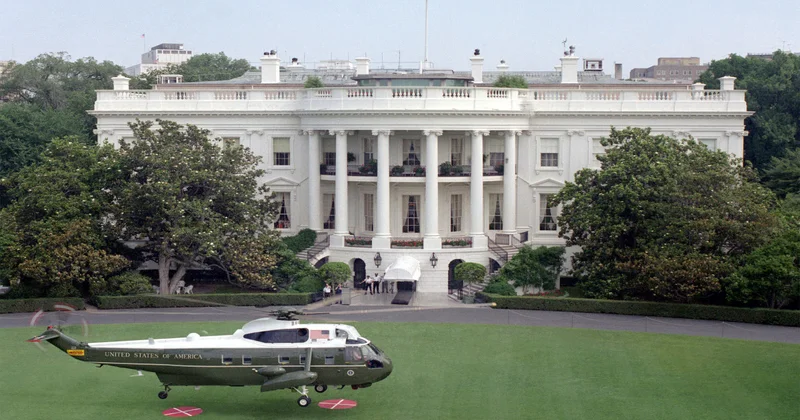

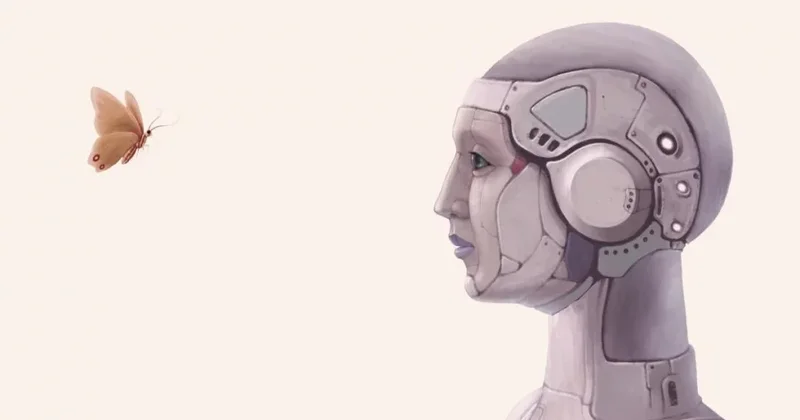

Süni intellekt insanlar kimi SƏHVLƏR EDİR

News24 portalından əldə olunan məlumata əsasən, Icma.az xəbər verir.

Süni intellektin insanlardan daha etibarlı qərarlar verəcəyi fikri yeni bir araşdırma ilə sarsılıb.

News24.az xəbər verir ki, OpenAI tərəfindən hazırlanmış ChatGPT ən təkmildirsüni intellekt modellərdən biri olsa da, insanların tez-tez buraxdığı qərar vermə səhvlərini təkrarlayır.

İnsana bənzər hezeyanlar nümayiş etdirir

Tədqiqatçılar ChatGPT-ni 18 fərqli bias testinə məruz qoydular və nəticələr təəccüblü idi. Model sınaqların təxminən yarısında həddən artıq özünə inam, qumarbazın səhvi və qeyri-müəyyənlikdən qaçma kimi insana xas idrak tələlərinə düşdü.Riyaziyyat və məntiq problemlərində qüsursuz çıxış edən süni intellekt subyektiv mühakimə tələb edən qərarlar qarşısında büdrəyib.

Məsələn, o, ehtiyatlı olmağı seçdi və daha riskli, lakin potensial olaraq daha sərfəli variantları götürməkdənsə, öz dəqiqliyini çox qiymətləndirdi. Yeni nəsil GPT-4 modeli, analitik cəhətdən daha yaxşı olsa da, bəzən mühakimə əsaslı tapşırıqlarda daha aydın qərəzlər göstərib.

Süni intellekt üçün də etik qaydalara ehtiyac varmı?

Tədqiqat göstərir ki, süni intellekt qərəzsiz qərar verən şəxs olmaqdan uzaqdır və insan qərəzlərini gücləndirmək riski daşıyır. Mütəxəssislər iddia edirlər ki, süni intellekt bir işçi kimi etik qaydalarla idarə edilməli və idarə olunmalıdır.

Səma

Baxış sayı:150

Baxış sayı:150 Bu xəbər 12 Aprel 2025 06:39 mənbədən arxivləşdirilmişdir

Bu xəbər 12 Aprel 2025 06:39 mənbədən arxivləşdirilmişdir

Daxil ol

Daxil ol

Online Xəbərlər

Online Xəbərlər Xəbərlər

Xəbərlər Hava

Hava Maqnit qasırğaları

Maqnit qasırğaları Namaz təqvimi

Namaz təqvimi Kalori kalkulyatoru

Kalori kalkulyatoru Qiymətli metallar

Qiymətli metallar Valyuta konvertoru

Valyuta konvertoru Kredit Kalkulyatoru

Kredit Kalkulyatoru Kriptovalyuta

Kriptovalyuta Bürclər

Bürclər Sual - Cavab

Sual - Cavab İnternet sürətini yoxla

İnternet sürətini yoxla Azərbaycan Radiosu

Azərbaycan Radiosu Azərbaycan televiziyası

Azərbaycan televiziyası Haqqımızda

Haqqımızda Əlaqə

Əlaqə

TDSMedia © 2026 Bütün hüquqlar qorunur

TDSMedia © 2026 Bütün hüquqlar qorunur

Günün ən çox oxunanları

Günün ən çox oxunanları