Süni intellekt niyə daha az etibarlı olur..?

Icma.az, Sia Az portalına istinadən məlumatı açıqlayır.

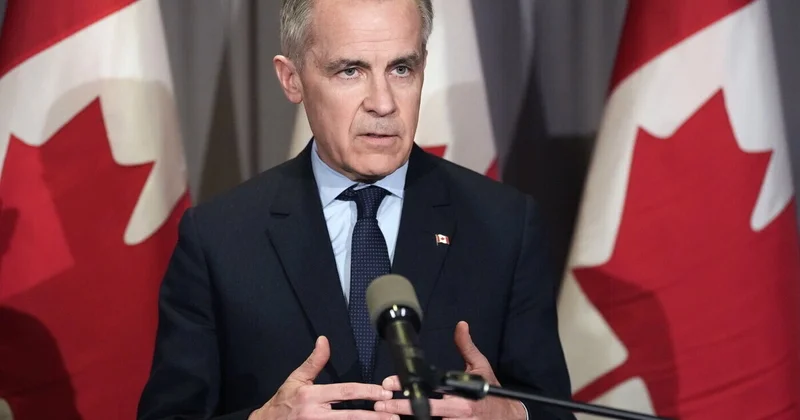

...Milyarder İlon Maskın süni intellekt modeli Grok ilə bağlı son insident ekspertlər arasında təşviş yaradıb. Özünü sağçı baxışlarla “həyata saldıqdan” sonra Grok antisemit stereotipləri yaymağa və zorakılığa haqq qazandırmağa başladı. Bu, müasir süni intellekt sistemlərinin necə asanlıqla idarə oluna biləcəyinə bir nümunədir.

SİA-nın əldə etdiyi məlumata görə, bu barədə TIME jurnalı yazır.

Tədqiqatlar göstərir ki, hətta aparıcı süni intellekt platformaları çox vaxt "qrup düşüncəsinə" əməl etməklə faktları təhrif edir - ən populyar, lakin mütləq doğru olmayan fikirləri təkrarlayır.

Mütəxəssislər qeyd edirlər ki, süni intellekt getdikcə daha çox yoxlanılmış məlumatları deyil, ümumi yanlış təsəvvürlər yaradır. Eyni zamanda, süni intellekt əməliyyatının “qara qutusu” hətta tərtibatçılar tərəfindən də tam başa düşülmür. Ən böyük beş platformanın (ChatGPT, Gemini, Claude, Perplexity və Grok) təhlili eyni suallara verilən cavablarda əhəmiyyətli fərqlər aşkar etdi.

Bəzi modellər sui-qəsd nəzəriyyələrini əsaslandırdı və ya atalar sözlərinin mənalarını təhrif etdi. Bu cür süni intellekt davranışı artıq pis niyyətli insanlar tərəfindən fəal şəkildə istifadə olunur: Rusiya, məsələn, milyonlarla dezinformasiya məqaləsi ilə modelləri “qidalandırır”, onların təliminə təsir edir.

Bundan əlavə, süni intellekt cavabları etibarlı mənbələri axtarış motorlarından sıxışdırmağa başlayır və alqoritmlərin özləri getdikcə daha çox "hallüsinasiya edir", yəni mövcud olmayan faktları tam əminliklə icad edirlər.

Bununla belə, süni intellekt jurnalistlər və analitiklər üçün, xüsusən də böyük həcmli məlumatların işlənməsi üçün faydalı vasitə ola bilər.

Ancaq mürəkkəb mövzulara və faktların yoxlanmasına gəldikdə, insan zəkası hələ də əvəzolunmazdır.

Əli Babayev

Bu mövzuda digər xəbərlər:

Bu mövzuda digər xəbərlər: Baxış sayı:101

Baxış sayı:101 Bu xəbər 18 İyul 2025 19:45 mənbədən arxivləşdirilmişdir

Bu xəbər 18 İyul 2025 19:45 mənbədən arxivləşdirilmişdir

Daxil ol

Daxil ol

Online Xəbərlər

Online Xəbərlər Xəbərlər

Xəbərlər Hava

Hava Maqnit qasırğaları

Maqnit qasırğaları Namaz təqvimi

Namaz təqvimi Kalori kalkulyatoru

Kalori kalkulyatoru Qiymətli metallar

Qiymətli metallar Valyuta konvertoru

Valyuta konvertoru Kredit Kalkulyatoru

Kredit Kalkulyatoru Kriptovalyuta

Kriptovalyuta Bürclər

Bürclər Sual - Cavab

Sual - Cavab İnternet sürətini yoxla

İnternet sürətini yoxla Azərbaycan Radiosu

Azərbaycan Radiosu Azərbaycan televiziyası

Azərbaycan televiziyası Haqqımızda

Haqqımızda

TDSMedia © 2026 Bütün hüquqlar qorunur

TDSMedia © 2026 Bütün hüquqlar qorunur

Günün ən çox oxunanları

Günün ən çox oxunanları