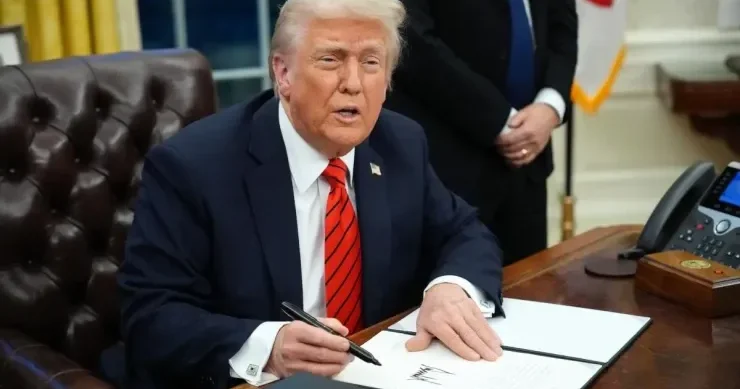

ChatGPT xəstəyə diaqnoz qoya bilməz Professor Adil Qeybulla

Sherg.az saytından alınan məlumatlara görə, Icma.az xəbər verir.

Diaqnoz qoymaq yalnız həkimin səlahiyyətində olan bir məsələdir

Son illərdə süni intellekt texnologiyaları insanların gündəlik və peşəkar həyatında mühüm yer tutmağa başlayıb. İstifadəçilərə pulsuz fərdiləşdirilmiş və əsaslandırılmış cavabları təqdim edən bu texnologiya həm də səhiyyə sahəsində məlumatların əldə edilməsi vasitəsinə çevrilib. Lakin bu vasitə riskli ola bilər.

Qeyd edək ki, ABŞ-də yaşayan 60 yaşlı kişi, süni intellekt əsasında fəaliyyət göstərən "ChatGPT"dən aldığı səhv məsləhət nəticəsində nadir rast gəlinən xəstəliyə - bromizmə tutulub. Kişi, adi duzun (natrium xlorid) sağlamlığa zərərli olduğunu öyrənərək, daha sağlam alternativ üçün "ChatGPT"yə "duzu nə ilə əvəz etmək olar?" sualını verib. Lakin "chatbot" ona, əlavə izah və xəbərdarlıq olmadan təhlükəli maddə tövsiyə edib. Kişi 3 ay ərzində gündəlik duz ehtiyacını tamamilə natrium bromidlə əvəz edib. Bununla da, onda ağır nevroloji və psixiatrik simptomlar inkişaf edib. Nəticədə o, psixiatriya klinikasına yerləşdirilib. Hazırda xəstə müalicə alır və vəziyyəti tədricən yaxşılaşır. Natrium bromid — qida üçün nəzərdə tutulmayan, əsasən baytarlıqda istifadə olunan maddədir. Uzunmüddətli qəbulu orqanizmdə yığılıb qalaraq sinir sistemi pozuntuları, halüsinasiyalar, paranoya və psixomotor həyəcan yarada bilir.

İnformasiya texnologiyaları üzrə ekspert Elvin Abbasovun açıqlamasına görə, süni intellekti tam başa düşmədən, mahiyyətini anlamadan istifadə etmək təəssüf doğurur:

“Süni intellekt sadəcə köməkçi alətdir, yaxşı təhlil edir. Eyni anda milyonlarla fikri, məqaləni təhlil edib, onun nəticəsini bizə verə bilir. Bunların hər birinin fonunda deyə bilərik ki, süni intellekt dövrün ən faydalı alətidir. Lakin onunla necə münasibət quracağımızı, hansı məsləhətləri necə qəbul edəcəyimizi bilməli, təqdim olunan məlumatları hansı mənbədən emal etdiyinə diqqət etməliyik”. Ekspert bildirib ki, süni intellekt insanların internetdə yazdıqları, akademik məqalələr, kitablar və digər məlumatlar əsasında bizə informasiya təqdim edir. Buna görə də bütün məlumatları dəqiq araşdırmalıyıq: Xüsusən də, sağlamlıqla bağlı məsələlər diqqət tələb edir. Süni intellekt xüsusilə texniki məsələlərdə daha çox faydalıdır. Amma sağlamlıq mövzusunda eyni şərhi bildirmək çətindir. Onun təqdim etdiyi məlumatların mütəxəssis tərəfindən təsdiqinə ehtiyac var. Həmçinin, süni intellekt istifadəsində hələ də etik məsələlər tam öz həllini tapmayıb, qanunvericilik təkmilləşməyib. Bu istiqamətdə tədricən işlər görülür. Ümid edirəm ki, gələcəkdə süni intellekti daha yaxşı başa düşəcəyik və onu hansı istiqamətdə istifadə etməli olduğumuzu düzgün qavrayacağıq”.

Professor Adil Qeybulla isə Sherg.az-a açıqlamasında qeyd edib ki, "ChatGPT" proqramları, süni intellekt texnologiyaları və digər bu kimi sistemlər vasitəsilə hər hansı bir xəstəliyə diaqnoz qoyulması qətiyyən məqsədəuyğun deyil:

“Diaqnoz qoymaq yalnız həkimin səlahiyyətində olan bir məsələdir. Təəssüf ki, klinik şəraitdə belə bəzi xəstəliklərin səbəbini müəyyənləşdirməkdə ciddi çətinlik çəkirik. O halda, hər hansı bir proqramın bu işin öhdəsindən gələcəyini düşünmək real deyil. Əvvəlcə qeyd etmək lazımdır ki, bu cür proqramlara verilənlər bazası yerləşdirilir. Proqram həmin məlumatlar əsasında assosiativ əlaqələr quraraq xəstəliyin nə ola biləcəyi barədə yalnız təxmin irəli sürə bilir. Bu isə sadəcə olaraq həkim üçün bir yardımçı vasitə kimi istifadə olunar. Lakin bir daha vurğulamaq lazımdır ki, yalnız bu sistemlərə əsaslanaraq diaqnoz qoymaq yolverilməzdir. Diaqnoz qoymaq üçün dünyanın hər yerində qəbul olunan dəqiq sübutlar-diaqnostik faktlar, patoqnomonik əlamətlər olmalıdır ki, onların əsasında xəstəyə konkret diaqnoz qoyulsun. Daha sonra bu diaqnoza uyğun şəkildə müalicə və profilaktik tədbirlər həyata keçirilir”.

Bu mövzuda digər xəbərlər:

Bu mövzuda digər xəbərlər: Baxış sayı:137

Baxış sayı:137 Bu xəbər 19 Avqust 2025 19:43 mənbədən arxivləşdirilmişdir

Bu xəbər 19 Avqust 2025 19:43 mənbədən arxivləşdirilmişdir

Daxil ol

Daxil ol

Online Xəbərlər

Online Xəbərlər Xəbərlər

Xəbərlər Hava

Hava Maqnit qasırğaları

Maqnit qasırğaları Namaz təqvimi

Namaz təqvimi Kalori kalkulyatoru

Kalori kalkulyatoru Qiymətli metallar

Qiymətli metallar Valyuta konvertoru

Valyuta konvertoru Kredit Kalkulyatoru

Kredit Kalkulyatoru Kriptovalyuta

Kriptovalyuta Bürclər

Bürclər Sual - Cavab

Sual - Cavab İnternet sürətini yoxla

İnternet sürətini yoxla Azərbaycan Radiosu

Azərbaycan Radiosu Azərbaycan televiziyası

Azərbaycan televiziyası Haqqımızda

Haqqımızda

TDSMedia © 2026 Bütün hüquqlar qorunur

TDSMedia © 2026 Bütün hüquqlar qorunur

Günün ən çox oxunanları

Günün ən çox oxunanları